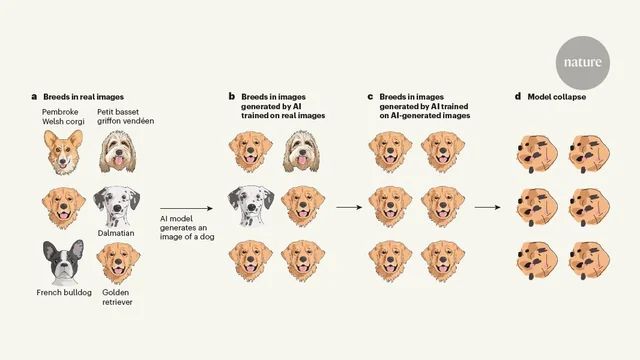

"Sự sụp đổ mô hình AI" xảy ra khi AI dùng dữ liệu do một hoặc nhiều AI khác tạo ra để huấn luyện, các mô hình sẽ dần sản sinh ra nội dung không còn chính xác, thậm chí vô nghĩa. Theo nghiên cứu đăng trên tạp chí Nature, việc sử dụng dữ liệu do AI tạo ra có thể khiến mô hình thoái hóa nhanh chóng. Ban đầu, AI có thể sản sinh ra nội dung sai lệch một chút, nhưng theo thời gian, sự sai lệch này ngày càng tăng dần, dẫn đến các thông tin hoàn toàn vô nghĩa.

Trong một thí nghiệm, các nhà nghiên cứu đã cho AI sử dụng dữ liệu do chính nó tạo ra để huấn luyện qua nhiều thế hệ. Kết quả cho thấy sau một số thế hệ, các mô hình AI bắt đầu sản sinh ra các nội dung không còn liên quan đến dữ liệu ban đầu.

Ví dụ trực quan cho "Sụp đổ của mô hình AI" - kết quả cuối cùng hoàn toàn vô giá trị

CHỤP MÀN HÌNH

Hiện tượng này là một vấn đề lớn đối với các công ty phát triển AI như OpenAI, công ty đã tạo ra ChatGPT. Các công ty này phụ thuộc vào dữ liệu từ internet để huấn luyện mô hình của họ. Khi ngày càng nhiều nội dung do AI tạo ra xuất hiện trên mạng, các mô hình sẽ gặp khó khăn trong việc tìm kiếm dữ liệu "sạch" và đáng tin cậy. Điều này có thể dẫn đến sự suy giảm chất lượng của các mô hình AI.

Để ngăn chặn "sụp đổ của mô hình", các chuyên gia đề xuất các công ty công nghệ cần sử dụng dữ liệu do chính con người tạo ra để huấn luyện AI. Một giải pháp khác là sử dụng "watermark" - dấu hiệu đặc biệt trong nội dung do AI tạo ra, giúp dễ dàng nhận diện và loại bỏ chúng khỏi dữ liệu huấn luyện.

Ngoài ra, việc bảo vệ dữ liệu huấn luyện và duy trì sự minh bạch trong quá trình phát triển AI cũng rất quan trọng. Các công ty cần hợp tác chặt chẽ để đảm bảo các mô hình AI vẫn hoạt động hiệu quả và không bị nhiễm "độc" từ nội dung do AI tạo ra.

Bình luận (0)